百万上下文、1.6T 参数、百万上下文、顶级推理,deepseek V4全面对标 Claude/GPT,还开源

两个模型,V4-Pro 和 V4-Flash,上下文窗口直接拉到1M,参数拉到1.6T,并且是DeepSeek所有官方服务的标配(可以装一整个项目)。

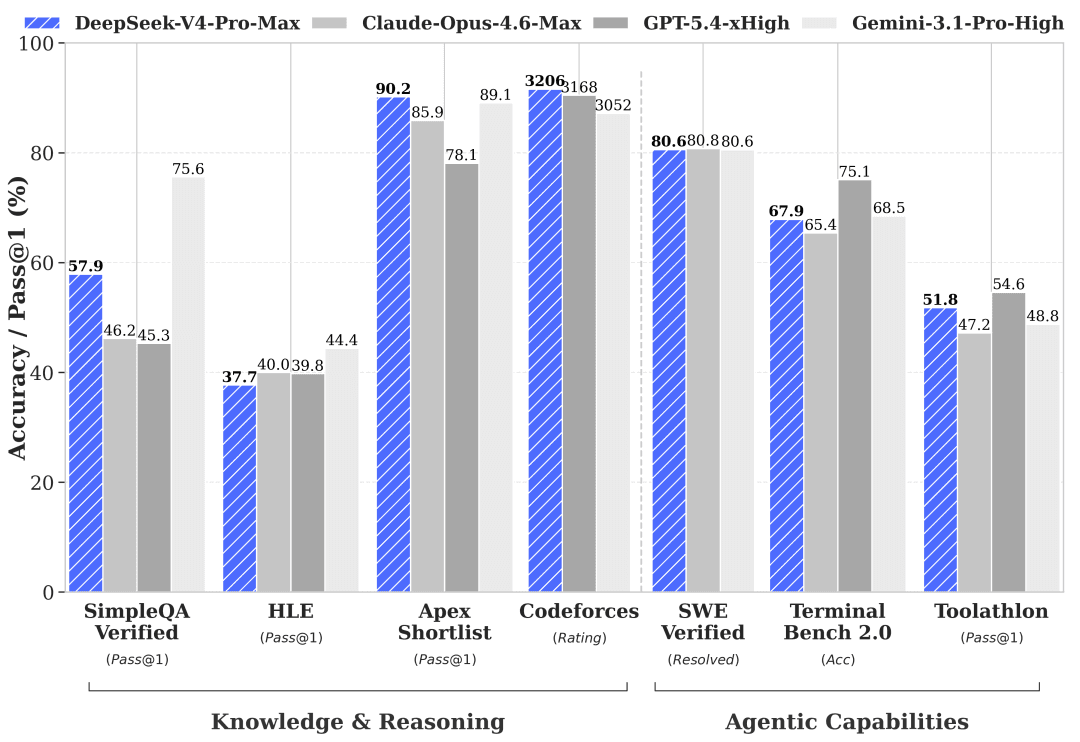

V4-Pro:对标顶级闭源模型

Agent能力大幅提升: 在代码类Agent评测中,V4-Pro已经达到开源模型最佳水平。DeepSeek内部已经把V4-Pro作为员工的Agentic Coding主力模型——据反馈,使用体验超过了Claude Sonnet 4.5,交付质量接近Opus 4.6非思考模式。

世界知识储备丰富: 在世界知识评测中,大幅领先其他开源模型,仅次于Gemini-Pro-3.1。

推理能力强:在数学、STEM、竞赛级代码等评测中,超越了所有已公开的开源模型,成绩比肩世界顶级闭源模型。

V4-Flash:更快更便宜

V4-Flash的推理能力和V4-Pro很接近,知识储备稍弱一些,但因为模型更小,速度更快、API价格更低,适合对成本敏感的场景。简单任务上和V4-Pro不相上下,复杂任务有一定差距。

两个关键技术突破

全新的注意力机制

V4开创了一种在token维度做压缩的注意力方案,配合DSA稀疏注意力,在实现超长上下文的同时,大幅降低了计算量和显存占用——百万上下文不再是硬件杀手。

Agent场景专项优化

针对Claude Code、OpenClaw、OpenCode、CodeBuddy等主流Agent产品做了适配,在代码生成、文档生成等任务上表现均有提升。

怎么用

在线体验

登录官网 或官方App即可使用。

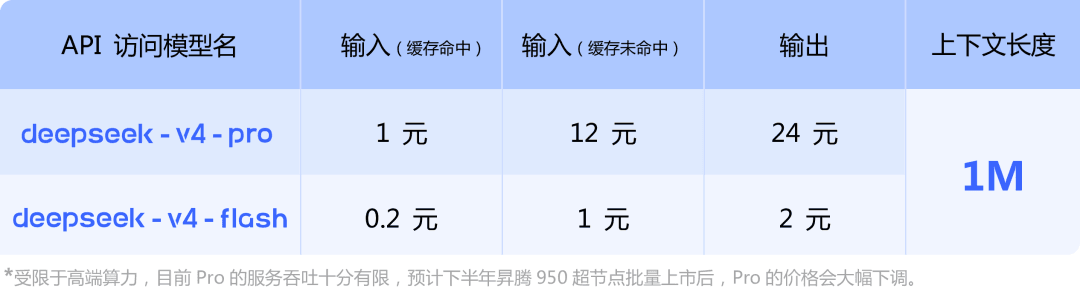

API调用

接口已同步上线,支持OpenAI ChatCompletions和Anthropic两种接口格式。base_url不变,model参数改为 `deepseek-v4-pro` 或 `deepseek-v4-flash` 即可。

两个模型都支持普通模式和思考模式,思考模式可通过 `reasoning_effort` 参数调节强度(high/max),复杂Agent场景建议用思考模式并设为max。

注意: 旧模型名 `deepseek-chat` 和 `deepseek-reasoner` 将在三个月后(2026年7月24日)停用。目前这两个名字分别指向V4-Flash的普通模式和思考模式,建议尽快切换到新名称。

最后

deepseek 永远滴神!!